L’intelligenza artificiale e l’arte della guerra

Le IA sono diventate parte della macchina militare senza bisogno di ribellioni fantascientifiche

Di Ivo Silvestro

Dalle vignette sui robot che graziano chi è stato gentile con loro alla guerra in Iran: le IA sono diventate parte della macchina militare senza bisogno di ribellioni fantascientifiche. E la realtà si è confermata più inquietante del nostro immaginario.

Le avrete viste, quelle vignette che circolavano online: i robot si ribellano e sterminano o riducono in schiavitù l’umanità – ma risparmiano il tizio che ringraziava sempre ChatGPT. Ci sono diverse varianti, incluse quelle scettiche in cui l’utente gentile è il primo della lista perché con quel “grazie” consumava risorse di calcolo (immaginiamo utili per progettare la ribellione).

La ribellione delle macchine

Il meme funziona – o forse dovremmo dire: funzionava – perché combina la nostra esperienza quotidiana con le intelligenze artificiali generative all’immaginario della fantascienza sulla ribellione delle macchine: le saghe di Terminator e di Matrix sono tra gli esempi più rappresentativi, ma l’elenco potrebbe prendere un paio di pagine di ticino7 e risultare ancora incompleto.

© Keystone

Dal film ‘Matrix’

Stranamente, la raccomandazione implicita ha senso, ma non per tutelarci da possibili apocalissi robotiche. Secondo alcune ricerche, tra cui quelle di Federico Germani e Giovanni Spitale dell’Università di Zurigo, essere gentili è una buona strategia per far fare alle IA quello che si vuole (incluso produrre disinformazione, ma questo è un altro discorso). Non per gratitudine o riconoscenza: è semplicemente questione di ottimizzare il processo di generazione del testo. E quest’ultimo punto è fondamentale: come non provano gratitudine o riconoscenza, le IA generative non hanno neanche obiettivi propri nel senso in cui li intendiamo noi e non pianificano vendette verso l’umanità. Possiamo, e forse dobbiamo, preoccuparci delle conseguenze sociali ed economiche della loro diffusione, ma per la ribellione delle macchine c’è tempo.

© Depositphotos

Una nuova battaglia

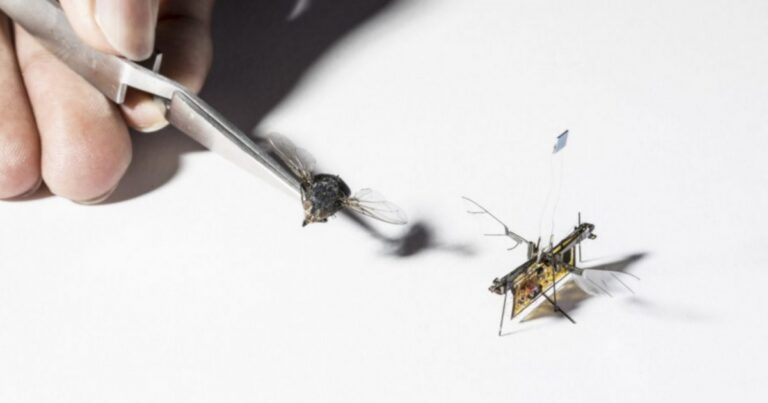

Questo era lo scenario rassicurante fino a poco tempo fa. Adesso sappiamo che le IA generative sono in battaglia. A gennaio la cattura del presidente venezuelano Nicolás Maduro è stata pianificata grazie a Claude di Anthropic, un modello di IA generativa disponibile a chiunque (anche se non nella configurazione predisposta per il Pentagono). E dall’inizio della guerra in Iran sempre Claude ha suggerito centinaia di bersagli in Iran, fornendo coordinate precise e indicando la priorità dei vari attacchi (tra i quali figurerebbe, secondo alcune ricostruzioni, anche la scuola elementare femminile Shajareh Tayyebeh di Minab).

Passi indietro

Anthropic ha poi deciso di tirarsi indietro: il governo americano chiedeva di rimuovere due limitazioni che l’azienda ritiene irrinunciabili, ovvero niente sorveglianza di massa di cittadini americani e niente sistemi d’arma completamente autonomi. Non che queste “linee rosse” rendano Anthropic particolarmente virtuosa, visto che ammettono tranquillamente sia la sorveglianza di cittadini non americani sia sistemi automatici per “semplificare la catena delle uccisioni”. Quando una IA indica, con la sicurezza tipica di questi sistemi, ottanta luoghi da colpire o persone da eliminare, l’approvazione umana diventa una semplice finzione che ha solo lo scopo di rassicurare le coscienze di chi ha progettato quella IA. Senza dimenticare il tema, tutt’altro che secondario, di un’azienda privata che decide in piena autonomia cosa sia giusto e cosa sia sbagliato.

Per scopi militari

Anthropic ha fatto la sua scelta; ChatGPT ne ha fatta un’altra, approfittando dell’esclusione del concorrente per negoziare un accordo commerciale con il Pentagono – cosa che ha portato a diverse campagne di boicottaggio dall’impatto incerto (perdere utenti privati, molti dei quali con piani gratuiti, potrebbe paradossalmente migliorare i conti dell’azienda). Fatto sta che quei meme sui robot riconoscenti improvvisamente sono diventati meno divertenti. Non perché le macchine si siano ribellate, ma per l’esatto contrario: perché hanno semplicemente fatto quello che è stato chiesto loro di fare.

Come peraltro avviene da tempo. Il Venezuela e l’Iran non sono i primi casi in cui l’intelligenza artificiale è usata per scopi militari: da anni questi sistemi vengono impiegati per analizzare dati di intelligence, elaborare immagini satellitari, identificare pattern nelle comunicazioni intercettate, condurre simulazioni e, come del resto accade ormai in qualsiasi ufficio, scrivere e-mail e rapporti. Solo che il Pentagono non è un ufficio qualsiasi: quell’eccesso di fiducia che abbiamo verso le IA generative, così brave a proporci testi convincenti e persuasivi, non porta a inviare un’e-mail senza rileggerla bene, ma a bombardare bersagli. Senza poter mandare una seconda mail correggendo l’errore commesso da ChatGPT.

© Keystone

Il Pentagono, a Washington, visto dall’alto

Soldati ubbidienti

Le IA non ci faranno la guerra come nei film. Non si ribelleranno, non svilupperanno coscienza, non proveranno né rancore né riconoscenza. Ma sono già sui campi di battaglia, ubbidienti soldati che eseguono i compiti che vengono affidati loro. Il nostro immaginario collettivo si è preparato all’apocalisse sbagliata e per salvarci non basterà ringraziare ChatGPT. Più utile, prima di tutto, conservare un certo scetticismo verso quello che le IA generative ci dicono. E, soprattutto, pretendere un dibattito democratico su quali usi siano leciti e quali illeciti, per non lasciare la scelta a un’azienda privata o a governi che, un po’ ovunque nel mondo, non paiono avere particolarmente a cuore i diritti.

© Adobe/Firefly